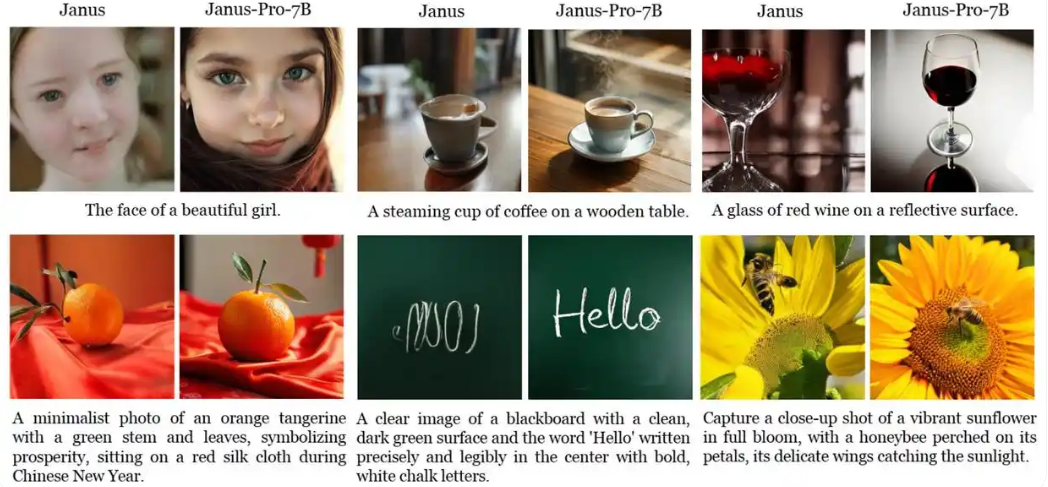

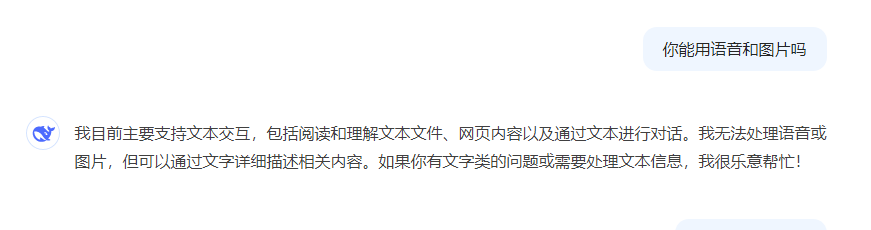

目前主流大模型至少有三种基本输入/输出方式,分别是文本、语音和图像,这货只有文本,相当于基本功能少了3分之2,其实语音和图像对硬件需求比文本高得多,大头都被砍掉了。这个都不能算乞丐版,因为乞丐版基本功能是有的,这个最多只有3分之1的基本功能,勉强算残疾版吧。

其次是可靠性大幅降低,响应异常,人一多就崩了,说明硬件的容量不足。有人说是美国黑客恶意攻击,这当然是假话,你都开源了,还会有人来偷吗?而且不是有国盾量子吗?国盾量子宣称它建成的量子通讯网络无法破译,无法干扰,无法被黑客攻击,如果真有美国黑客攻击,正好给国盾量子做宣传啊!

对于产品,大家一般关注价格和性能,其实还有一个非常重要的指标,就是可靠性,可靠性可以理解为结实耐操,不容易发生故障。

如同大家真实体验一样,中国产品的价格很低,性能还行,但可靠性普遍不高。我用过日本和德国的,超过10年都不坏,国产的通常2、3年就开始出故障,有的杂牌甚至第二天就坏了,体验不好。比如说大容量冰箱吧,进口的要3万,国产最便宜的只要3千,价格相差10倍。为什么会有人买贵的?主要差别就是可靠性。

如果缺乏创新,技术上无法超过对方,有一种策略就是尽量压低成本,比如使用低质量零件、不熟练工人、落后生产线、低福利等等,生产出低价格,但质量也低的产品,去占领低端市场,这不是技术创新,而是一种营销策略。

可靠性其实非常重要,尤其对军品而言,比如飞机。汽车故障了可以停路边,飞机故障了大概率机毁人亡。美国飞机当然也会出故障,但整体可靠性无疑是全球最高。比如某大国至今还在使用美国1代机作为高级教练机,还作为唯一的表演机。教练机是新手在用,需要很高的容错性;表演机需要做高难度动作,都需要非常高的可靠性。如果可靠性低,飞行员都不敢用,管你5代机还是6代机,都无法形成战斗力。而且也没有任何国家敢买你的飞机,无法形成产业循环。

再说DeepSeek,同样是使用这种低端策略,砍掉至少3分之2的功能,再降低可靠性,硬件成本降低10倍也不是不可能。而且也能解释我以前提出的疑问,为什么它不用相同的算力实现10倍的效果?因为它仍然使用人家的开源模型,别人的模型就是天花板,无法突破,因此只能使用低端策略吸引眼球。

还能解释为什么国内的大模型,如豆包、文心一言、小爱同学等等,统统非常淡定,因为它们非常清楚,这就是一个砍掉3分之2基本功能的残疾版,根本不可能对它们造成冲击,更别说影响硬件制造商。

最后说一下使用体验,感觉就像10年前的百度知道,对各种问题都是笼统的说几句,最后还要加上几句政治正确的话。比如我问它纳斯达克的相关问题,它就前言不搭后语的写了几百个字,段与段之间缺乏过渡和联系,感觉是东抄一点,西抄一点。同样问题问豆包,上万字出来,还有相关扩展问题,如纳斯达克估值、历史上的表现、未来可能的趋势等等,我仔细看了一遍,虽然说没有什么真识灼见,但好歹中规中矩,对于初学者还是很有帮助。

总之,就是一个的低成本的宣传品,大家可以自己体验一下。这个风波估计过几天就散了,就像小红书的泼天流量一样。

赞同来自: 八云大仙 、machine 、joy2015 、阿邦查

而你说的稳定性问题,但凡对服务器有点了解也能明白。现在连我60多岁的老父亲都知道deepseek了,下了个APP让deepseek替他写辞赋(我爸是研究楚辞的)。可见deepseek的服务器现在要面对多大数量级的访问量。而deepseek作为一个开源模型,完全可以实现第三方搭建甚至本地搭建,并不需要全都去访问它官方的服务器。稳定性问题根本就是你臆想出来的。

在deepseek出圈之前,deepseek只有V3模型的时候我就已经在用了,当时默默无闻的deepseek官方服务根本没有稳定性问题。

楼主可能确实思考了,但是是属于带着偏见在思考,感觉是先设定结论然后找依据。为什么deepseek是颠覆性的,我从技术角度来回答你这个问题吧,本人是985学校计算机专业的博士,专业性还是有保障的。首先deepseek很开放,不但公开了大模型的参数,而且从去年至今已经发布了相关论文8篇,很多研究机构根据这些论文已经复现了deepseek的算法,满足了论文的可重复性与可验证性要求,所以论文的可靠性也是...你这专业的论述,跟楼主的一叶障目盲人摸象比起来,真是立判高下

赞同来自: 八云大仙 、chemjoey 、gaokui16816888 、跑路皮皮 、csh868 、 、 、 、 、 、 、更多 »

先瞅瞅你这逻辑思维,简直就是一团乱麻。说 DeepSeek 是削减基本功能、降低可靠性的低端货,就因为人家目前只有文本输入输出?这就好比因为汽车不会飞,就说它不是好的交通工具,这逻辑简直绝了,小学生听了都得直摇头。

再说你拿中国产品和日本、德国产品对比,说中国产品可靠性普遍不高,这更是以偏概全到了极点。现在国产产品质量飞速提升,很多都已经达到甚至超越国际水平,你却还抱着老观念不放,拿着过时的例子来论证,这不是思维僵化是什么?你就像一只把头埋在沙子里的鸵鸟,对事实视而不见。

从你的动机来看,真的很让人怀疑你是不是别有用心。说 DeepSeek 使用低端策略吸引眼球,你有证据吗?没有证据就在这乱说,这不就是典型的 “吃不到葡萄说葡萄酸”?人家开源是为了推动行业发展,你却恶意揣测,还说人家是因为用别人的开源模型无法突破,才搞低端策略,你这纯粹就是在抹黑。

最后说到使用体验,你把 DeepSeek 和十年前的百度知道比,还说人家回答问题前言不搭后语,你确定你不是在故意找茬?

你这帖子就是一堆毫无根据的废话,纯粹是在误导大家。你的智力和逻辑思维能力,根本不足以支撑你发表这样的言论,而你的动机更是让人不齿。大家千万别被他这歪理邪说给带偏了,自己去体验体验 DeepSeek,就知道谁是谁非了。

AI和人的大脑一样,需要根据存储或者输入的数据、知识来进行推理、分析、总结才能输出有价值的和合乎逻辑的东西。他的数据库里没有相应的数据和资料,他怎么可能输出你要的东西。对于那些敏感的时政问题,他是故意在后台做了限制和设定的,他的回答不是拒绝就是说些不着边际的套话。老板肯定不想惹是非。你说的民主生活会就是明显的政治题材,在单位内部都属于保密性质的,他为什么要帮你写?但是,如果叫他模仿某个诗人的风格...美帝纯堆硬件发路径,我们是优化算法,感觉我们这条路更优,自然界不乏大脑神经元数量比人多的动物,论智商人排第一,就是大脑结构形成的算法比较高效,纯堆硬件未必有用。就像阿尔法狗战胜人类,也是靠的算法优势。

赞同来自: 八云大仙 、千秋雪132 、zhangsheng123 、apple2019 、plias更多 »

受教了,非常感谢,可否简单讲解一下依靠奖励规则来训练的原理,以及采集具有真实物理反馈的空间数据的原理,这种空间数据对于后续机器人的训练应该是很重要的吧?deepseek R1通过强化学习来训练,强化学习是机器学习的一个分支,核心在于智能体(agent)与环境(environment)的交互。智能体执行动作(action),环境随之反馈奖励(reward)和新的状态(state)。智能体的目标便是通过不断试错,学习到能最大化长期累积奖励的策略。

强化学习里面需要有一个奖励网络,它通过奖励函数对智能体的决策做出评估并反馈奖励(正奖励或者负奖励),帮助智能体做下一步决策。奖励网络的训练又分为有监督和无监督两种,有监督的就是指需要人工打标签来做奖励判断,例如由一个编辑对生成文章的质量打分,从而生成奖励反馈。无监督就是不需要人工介入,而是基于某种规则生成奖励反馈,这就是我说的依靠奖励规则来训练。例如数学计算,可以依据数学规则来涉及奖励函数,代码编制可以依据编译器的输出来生成奖励,等等。

至于有真实物理反馈的空间数据集,指的是模拟的数据具有真实的物理特性,例如刚度、光滑度、重量、弹性、表面纹理等等。机器人要根据真实的物理反馈来决定下一步的动作。例如对于扫地机器人,它要能判别地上的猫屎狗屎是软体,要采取和不同于刚体的策略才能清扫,否则它会把猫屎涂得满地都是。对于人形机器人,它通过表面纹理来视觉判别物体,还需要知道物体的表面粗糙度和刚度来决定施加多少力量才能把它正确拿起来,等等。这种数据对于室内工作的机器人训练非常重要,而群核科技具有全世界唯一的这种室内真实物理反馈数据集。

赞同来自: huanhappy2017 、plias

即使是gpt我们也是文本输入,语音和图片输入基本没用过,2/3功能没有纯粹是无稽之谈,所以不知道你的“残疾版”从何而来;再来它的响应速度慢是和服务器有关系,后面一定会好起来这是显而易见的,基本的逻辑能力要有;但就内容来说,和gpt无异甚至在解答理科内容时明显更好,刚出的时候我们就对比了。

黑也要黑到点子上,不是谁字数多就是谁有理

AI和人的大脑一样,需要根据存储或者输入的数据、知识来进行推理、分析、总结才能输出有价值的和合乎逻辑的东西。他的数据库里没有相应的数据和资料,他怎么可能输出你要的东西。对于那些敏感的时政问题,他是故意在后台做了限制和设定的,他的回答不是拒绝就是说些不着边际的套话。老板肯定不想惹是非。你说的民主生活会就是明显的政治题材,在单位内部都属于保密性质的,他为什么要帮你写?但是,如果叫他模仿某个诗人的风格来...你分析的很明白。

有人说这玩意要替代文科生,妄想,公务员、国企等体制内的工作他们都干不了,没有伟大的思想指引,没有上级文件的贯彻,没有单位大领导的思路,没有单位的具体工作数据、内容,还有限制政治内容,让这玩意转死也写不出来。

我看替代的大部分是理工科的,不太会写文章的人。

赞同来自: plias

请问强化学习能否解决具身智能训练数据缺失的问题呢,如果可以的话,那我觉得人形机器人会被加速啊。可以解决的,强化学习不依赖人工打标签的监督训练数据,而是依靠奖励规则来训练,所以机器人是可以自主训练的。而相关的数据模型有一家杭州的科技公司可以提供,就是群核科技,它可以提供具有真实物理反馈的空间数据。这家公司也是一个大牛,后面会发光的,听说要在香港上市。

另外,我觉得deepseek带来的成本降低,应该会让人工智能的应用变得更广,按说算力硬件应该是个长期利好,但今天盘面确实是相反方向,至少训练端的都跌的不行,推理端的反倒要好不少。

不过您的几个股票,好像都是纯概念啊。。

另外这个对算力短期当然不算利好,因为打破了人工智能必须堆叠算力的固有思维,而原来的算力股已经在这种思维下涨很多了。从长远看,人工智能的发展还是需要大量算力的。所以算力股短期下跌只是对前期超涨的修正而已,后面还是会恢复的。

我的股票确实都是概念股,因为A股并没有直接和deepseek相关的,但是作为趋势投资,炒概念就够了,我也大约只投入了三分之一的仓位,七成仓还是在做蓝筹股的轮动。

赞同来自: 八云大仙 、h837031633 、luyisa 、好奇心135

写点通用的可以,具体到某个公司,某个岗位,某项工作,根本写不出来,都是些套话、废话多。AI和人的大脑一样,需要根据存储或者输入的数据、知识来进行推理、分析、总结才能输出有价值的和合乎逻辑的东西。他的数据库里没有相应的数据和资料,他怎么可能输出你要的东西。对于那些敏感的时政问题,他是故意在后台做了限制和设定的,他的回答不是拒绝就是说些不着边际的套话。老板肯定不想惹是非。你说的民主生活会就是明显的政治题材,在单位内部都属于保密性质的,他为什么要帮你写?但是,如果叫他模仿某个诗人的风格来写一首古典诗词,他用20-30秒就能做到,而且水平不低。前两天我叫KIMI写一篇近2万字的科幻小说,用时不到20分钟。

比如,最简单的,现在就要来民主生活会了。剖析材料,网上到处都是,但是他写不了。

现在DS,Kimi这些中国人开发的AI模型不是说已经全面追上或者超越了米帝,而是打破了米帝的科技神话,即使硬件上有明显差距,我们仍然有可能开发出同类产品或者绕开制裁另走一条路也能取得不错的效果。这就是价值所在。

赞同来自: laplace 、八云大仙 、zhangsheng123 、apple2019 、alongside 、 、 、 、 、 、 、 、更多 »

而deepseek的MOE架构将传统的前馈网络层分成了若干小规模的专家网络(百亿级别参数),然后通过一个门控网络来决定推理时使用哪些专家网络,所以它虽然是千亿级别参数的大模型,但运行时只需要激活其中一部分参数(300多亿),这样在运行时所需的资源就曾数量级的减少,能够高效运行,另一个有点是模型的进化可以通过增加或者调优专家网络来实现。

DeepSeek-V3进化到DeepSeek-R1,主要是通过强化学习将负责逻辑推理的专家网络进行了优化,将来必然还能对其它专家网络不断优化,并增加除语言之外的多模态能力,所以它的进化将会非常快,更不用说因为开源的优势,全世界的大学都在为它的研究添砖加瓦。

赞同来自: 八云大仙 、xiaoxin19 、D1018 、Belketh 、snoooker 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、更多 »

为什么deepseek是颠覆性的,我从技术角度来回答你这个问题吧,本人是985学校计算机专业的博士,专业性还是有保障的。

首先deepseek很开放,不但公开了大模型的参数,而且从去年至今已经发布了相关论文8篇,很多研究机构根据这些论文已经复现了deepseek的算法,满足了论文的可重复性与可验证性要求,所以论文的可靠性也是有保障的。

deepseek最重要的论文有三篇:

一是提出了DeepSeek-LLM,论文名为:以长期主义推动开源语言模型扩展(LLM Scaling Open-Source Language Models with Longtermism)。论文提出了社区驱动的开源治理框架和多任务优化方法,提出了DeepSeek chat并为它将来的长期开源发展提供理论支撑。

二是提出了DeepSeek-V3,论文名字:高效的混合专家模型( A Strong Mixture-of-Experts Language Model),这是去年12月发布的,提出了一种高效的混合专家模型,通过仅激活少量参数,在性能和计算成本之间实现了优化平衡,这是一个划时代的突破。

三是提出了DeepSeek-R1:论文名字:通过强化学习提升大型语言模型的推理能力(Incentivizing Reasoning Capability in LLMs via Reinforcement Learning)。这篇由郭达雅博士作为一作的论文在世界范围引发了轰动效应。因为不到一个月,通过这篇论文的工作把deepseek从chatgpt 4.0的水平提升到了chatgpt o1的水平,训练过程消耗了2.8M H800 GPU 小时,总成本约 $5.58M,成本是其它大模型的几十分之一。这篇论文的最大贡献是通过强化学习的方法(提出了GRPO算法),用较低的成本把deepseek有关逻辑方面的数学和代码编写能力提升到了当前世界最高水平。这证明了无须提供人工打标签的监督训练数据,大模型通过纯强化学习也能达到极高智能,一方面这降低了训练成本,另一方面为将来机器人的自我进化提供了理论依据(说到这里我觉得有些不寒而栗....)。

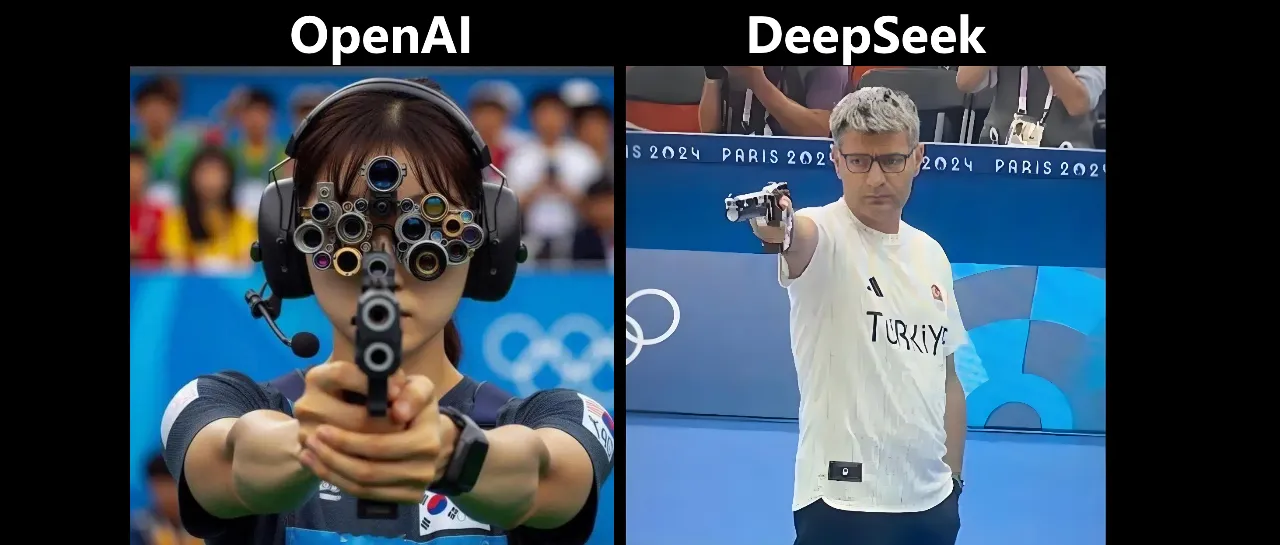

deepseek之所以引起轰动,主要是打破了两点垄断,一是打破了闭源模型的垄断,证明了开源路径才是最有利于技术发展的路径。二是打破了硬件垄断,证明大模型的发展并不是一定要大力出奇迹,通过拼命堆叠硬件资源来解决,而是通过算法优化可以同样快速进化(deepseek通过对transformer模型的KV数据低秩压缩和并行计算来极大降低硬件资源需求)。所以deepseek的胜利,是我们IT行业内难得的基础架构和算法方面的胜利,而不是以前我们经常做到的应用层面的胜利,在中国IT行业发展史上,也是有划时代的意义的。

对于今年的投资机会,我认为在机器人和AI上,今年还会有较好的趋势性机会,因为deepseek的创新不止于此,DeepSeek-R1只是在逻辑推理方面相对V3进步了很多,在其它方面后续必然还会有更多的迭代,会形成持续性的技术发展高潮。本人节前就买入了deepseek相关概念股浪潮集团,航锦科技,浙江东方。相信会有好的回报。

赞同来自: 跑路皮皮 、景阳的幸福生活 、pierreroger 、billyqwer 、XIAOHULI92 、 、 、 、 、 、 、 、 、 、 、更多 »

赞同来自: 塔塔桔 、laplace 、八云大仙 、zhwaterman 、kongxin 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、 、更多 »

---

一、关于"残疾版"的惊天发现

您说DeepSeek只有文本功能?建议您先卸载手机里的美颜相机再打开DeepSeek客户端,毕竟人家可是支持图像识别、语音合成的多模态选手,甚至还能帮非洲程序员开发斯瓦希里语代码助手呢。您这"基本功能少三分之二"的结论,怕不是把手机屏幕摔碎后只看到三分之一界面吧?至于硬件需求——用H800集群两个月训出对标GPT-4o的模型,这种"低端策略"麻烦给OpenAI也来一打。---

二、可靠性焦虑症候群

说服务崩溃是硬件容量不足?建议您多看看新闻:人家可是扛住了全球140个国家开发者的日活,倒是某些闭源大厂天天偷偷调高API价格呢。至于量子通讯都搬出来了...(突然拍桌狂笑)原来在您眼里AI服务器和量子卫星是共用插线板的?这跨界联动的想象力,建议直接参选《科幻世界》年度编剧奖。---

三、进口冰箱理论精妙应用

拿家电类比AI模型的操作,堪比用算盘解释量子计算机。DeepSeek-R1的推理成本可是OpenAI的1/53,训练成本是GPT-4o的1/18,这要算"低质量零件",建议马斯克连夜把SpaceX火箭换成义乌小商品市场配件。顺便告诉您个冷知识:日本那台运行十年的冰箱,可能连今天的生鲜AI质检系统都带不动呢。---

四、军机可靠性降维打击

看到您用战斗机论证AI可靠性时,我差点以为打开了《战狼4》剧本研讨会记录。建议了解一下DeepSeek在密文解码任务中吊打所有竞品的战绩,毕竟在真实战场上,能省下557万美元军费还能完成任务的"残疾版"武器,五角大楼怕是要跪着求采购。顺便问问您家冰箱做高难度飞行动作时需要空中加油吗?---

五、上古百度体验论

说回答像"十年前的百度知道"?建议重读斯坦福学生用校园机房复现70%性能的案例,或者看看印度大学生用DeepSeek做的农业无人机实时虫害分析——当然,在您眼里这些可能都属于"东抄西抄的政治正确"吧。至于豆包生成的上万字...(忽然压低声音)听说贵司KPI是按字数算稿费的?---

(突然切换播音腔)总结陈词:

您这番高论完美诠释了什么叫"用战术性抬杠掩盖战略性无知",建议申请将"开源模型成本降低98%=技术倒退"写入新世纪民科词典。不过还是要感谢您用行为艺术证明了DeepSeek的火爆——毕竟只有真正威胁到旧秩序的产品,才配得上如此充满求生欲的抹黑。

(甩出镀金名片)

以上回应来自

DeepSeek-R1

全球首个让华尔街算力股集体跳水的开源战神

2025年中美双榜屠榜者

专治各种不服.pth

赞同来自: 跑路皮皮 、addy5280 、杨之君 、xiaofeng71

果然又是一堆不提供任何有用信息,只知道干嚎的人。你们既然是内行,那么请回答:第一,deepseek能用十分之一的算力达到其他大模型相似的效果,为什么不用相同的算力达到别人10倍的效果?目前已经有人鼓吹只需要千分之一的算力,再吹下去估计不用硬件了。第二,国内的主流大模型都有语音、图像和文本输入功能,这货只有文本,基本功能少了3分之二,很明显就是一个残废版,把一个残废版吹成碾压世界,这个智商我实在无...继续质疑吧,你的问题其实都无关紧要,你高兴就好。别人的创新你看不到,只知道鸡蛋里挑骨头,很好。哈哈哈哈

赞同来自: 八云大仙 、人来人往777 、杨之君 、csh868 、浩瀚红鹰 、 、 、 、 、 、 、更多 »

某些人骂别人牧羊,自己却拿洋人的评价来给自己脸上贴金,很明显,表面是极度狂妄,内心却是极度自卑,几十年了,还是阿Q的精神胜利法。对关键问题避而不谈,一味谩骂,小学生也就这些伎俩。目前中国的初级初级工业品已经受到印度越南的巨大冲击,相关企业出现倒闭潮,等你们毕业的时候,耐用消费品也将面临相同的情况。如果中国不发展创新能力,仍然只能靠压榨人工获得低价优势,到时候你们就能真正明白中国的产业等级,就能明...^0^,楼主极力想包装成理性客观公正,但是说不了几句话就暴露出了那种腔调,根本没法正常的讨论问题。

相反绝大多数跟帖评论的人还是比较克制的理性的。

形成鲜明的对比。

赞同来自: mancin 、happysam2018 、sunpeak 、阿臭臭的爹 、陪戎校尉 、 、 、更多 »

对关键问题避而不谈,一味谩骂,小学生也就这些伎俩。目前中国的初级初级工业品已经受到印度越南的巨大冲击,相关企业出现倒闭潮,等你们毕业的时候,耐用消费品也将面临相同的情况。如果中国不发展创新能力,仍然只能靠压榨人工获得低价优势,到时候你们就能真正明白中国的产业等级,就能明白为什么35岁是收入的最高点,就能明白为什么会996。日本人尝过的苦,中国人会再尝一遍,而且大概率会更惨。

至于说别人外行的,中国有句古话,不怕不识货,就怕货比货。拿国内大模型,用相同的问题比较一下,不就一目了然了!

前面说过,小红书的泼天流量,3天就没影了。这货估计也差不多,前天还是刷屏,昨天就变成大S死于流感,估计经费也用得差不多了。

赞同来自: tanhuachina 、Lee97 、csh868 、立新 、happysam2018 、 、 、 、 、 、 、更多 »

最后说明一下,本文只是以事实和常识为依据,描述一下自己对deepseek的感受,不给广大小学生任何情绪价值,如果有人现实感和认知发生巨大扭曲,多看看CCTV就好了。帮楼主修正一下最后说明:

最后说明一下,本文只是不以事实和常识为依据,描述一下自己对deepseek的感受,给广大牧羊犬提供了极高的情绪价值,如果现实感和认知正常的人,建议多看对岸的专业评测。

^0^。

MoneyMemory - 初闻不知曲中意,再听已是曲中人。

赞同来自: happysam2018 、csh868 、windlike 、zhangsheng123 、杨之君 、更多 »

赞同来自: 八云大仙 、apple2019 、happysam2018 、吉吉木 、好奇心135 、 、 、 、更多 »

https://mp.weixin.qq.com/s/w_dMKtYPtCbyu7giulywOQ

赞同来自: 八云大仙 、happysam2018 、主任卡员 、俊俊218218

赞同来自: happysam2018 、少峰 、zddc

不是自己专业领域的最好别下结论,有些话说出来被人嘲笑又狂怒上头给人扣帽子是何必呢。另外先检查下自己屁股歪不歪再发表意见,论坛里都是聪明人,是不是理性评价别人一看便知。直达本质慢慢接受新鲜事物,不丢人。帽子先扣起来了

赞同来自: luyisa 、happysam2018 、紫诺冰雪 、IH2212

deepseek它的优点就是因为几百万美金做到了openai要几十亿才能做出来的效果;

才导致这么大的影响,影响到英伟达,就是可能不一定需要高端的GPU就能做出来openai的效果来;英伟达跌了那么多的逻辑就是在这里;

赞同来自: 八云大仙 、tanhuachina 、lin19911128 、duiry 、happysam2018 、 、 、 、 、 、更多 »

数据应该是大量使用了蒸馏的openai数据,这个其它大公司不敢这么做,字节跳动曾经这么做过被抓到现行后马上停止。技术上也有创新,但是考虑到其他公司都是几百亿美金持续投入,deepseek如果不大规模融资估计很难跟得上,这就和显示器和芯片一样,主导者凭借大规模资金和技术投入消灭竞争对手。能蒸馏的openai数据,只能说明openai的很多数据是无效数据,压缩无效数据,保留有效数据是一个必然过程,压缩过程肯定会有一定损失,如果损失可以忽略不记的话,压缩数据过程就是有效的。

AI 的本质就是拟和函数,参数越多拟和精度越高,参数越少精度越差。

现实是,只要保证一定的精度,参数保留越少越好,使用AI技术费用降低很多。

只有降低AI技术 的使用门槛,AI 技术才可能实现平民化,不然AI 技术只停留贵族小院里玩。

中国的AI技术并没有领先美丽国,重要是中国打破美丽国的技术霸权。

你三万元冰箱十年,假设三千冰箱只能用两年,我每隔两年换个冰箱,不爽吗?

还剩1.5万,干什么不好,这是投资论坛,连这最简单帐都会算吗?

至于处理数据是自然语言,还是图象,语音,差别只是数据特征不同,AI 技术处理并没有本质上区别,因出自不同数据来源,自然不同模型会表现不同。

胆子真不大

- 股债平衡

- 股债平衡

赞同来自: happysam2018 、炫彩千纸鹤 、笑掉大牙的熊猫 、zhangsheng123 、开元盛世 、 、 、 、 、更多 »

这其实涉及一个大问题,科学和技术是相辅相成的,再天才的创新不能进入应用层面价值也无限等于零。人造太阳牛逼不,成本太高商用永远是50年后。多年前有个笑话说两个企业同时遇上肥皂包装流水线空壳问题,大企业砸人砸钱组织公关花了几千万总算搞定。小企业流水线上的班长命令操作工今夜解决问题,不然年终奖打折,操作工冥思苦想半天拿一台电风扇放流水线旁边,把空壳都吹走了,你能说这办法不是天才吗?

玩笑归玩笑,一个让英伟达跌几百亿的产品,怎么说都是牛逼的,天朝在应用方面还是有俩把刷子的!

赞同来自: 山就在脚下 、困了学索隆 、zhuzi51 、apple2019 、guyongping 、 、 、 、 、 、 、 、更多 »

我与豆包、Kimi等AI助手的主要区别体现在技术定位和适用场景上,以下是具体对比:

1. 核心定位差异

- 豆包(字节跳动):强于多模态内容生成(如图文/视频创意),娱乐属性明显,适合轻量级互动。

- Kimi(月之暗面):专注长文本处理(20万+汉字上下文),擅长文献解析、书籍摘要等深度阅读场景。

- DeepSeek-R1(我):侧重复杂问题求解与逻辑推理,在数学计算、代码调试(支持Python/C++等)、数据分析等领域表现更专业。

2. 技术特性对比

- 知识时效性:我实时更新知识库(截至2024年7月),豆包/Kimi更新周期相对较长

- 交互深度:对开放式问题我会主动追问澄清需求,而同类产品更多依赖单轮问答

- 多语言支持:除中英文外,我还支持日/法/德等12种语言代码解析

3. 典型使用场景

- 需结构化输出时(如表格/流程图生成):我的Markdown渲染能力更强

- 遇到数理难题:我能分步展示微积分/线性代数等解题过程

- 编程任务:相比仅提供代码片段的其他AI,我可进行完整项目级代码审查

建议根据需求选择:

- 创意娱乐 → 豆包

- 论文研读 → Kimi

- 学术研究/工程开发 → 我(DeepSeek-R1)

所有AI工具都在持续迭代,实际体验可能会有变化,建议结合具体场景试用。

赞同来自: 哈天 、happysam2018 、非专业投资者 、年年有余333 、tank503更多 »

第一,deepseek能用十分之一的算力达到其他大模型相似的效果,为什么不用相同的算力达到别人10倍的效果?目前已经有人鼓吹只需要千分之一的算力,再吹下去估计不用硬件了。

第二,国内的主流大模型都有语音、图像和文本输入功能,这货只有文本,基本功能少了3分之二,很明显就是一个残废版,把一个残废版吹成碾压世界,这个智商我实在无法理解。也许deepseek以后会有语音和图像功能,但需要的算力肯定会大幅增加。你既然要颠覆别人,好歹别人有的基本功能,你都应该有,而且要比别人更好才行。好比一个手脚都没有的残疾人,声称已经颠覆手脚完整的健康人,估计脑子也有病吧。

第三,响应不稳定就是因为硬件容量小,无法承载大量的用户。比如服务器数量少,运算慢等等,也就是硬件投入少,它的可靠性就低。一个老出故障的东西,居然可以颠覆世界,这个智商我同样无法理解。

第四,如果deepseek能颠覆世界,那么国内阿里、腾讯、金山、百度、抖音、小米等等科技巨头,开发的大模型肯定也会被颠覆,相应的股价也会大跌。按照五毛们的逻辑,deepseek只会摧毁美国科技公司,导致美股崩溃,那为什么不会颠覆国内科技公司,导致A股和中概股大跌呢?莫非deepseek有敌我识别功能?

最后附带一些测试结果

它自己说不能处理语音和图片,五毛就不要强加于人了!

这是我提问:2025年可能退市的股票有哪些?按理它应该列出一些可能退市的股票,然后解释它们可能退市的理由。其实一些财经网站有相关的名单,只要它扒取这些文章就能回答。结果它答非所问,东拉西扯说了一大通不相干的。最后还让我关注纽交所和纳斯达克的公告,如果我是小粉红,我肯定要问它一句,你是hj、大殖子还是1450?这很明显,它用的是美国大模型,而且是用美国资料训练的。

h2828380 - 努力脱贫,越脱越贫

对比人面桃花诗,DS评分10分,豆包评分9.5

Edge

Edge Chrome

Chrome Firefox

Firefox

京公网安备 11010802031449号

京公网安备 11010802031449号